چین به سوءاستفاده از هوش مصنوعی کلود متهم شد

ICTPRESS - همزمان با بحثهای آمریکا بر سر صادرات تراشههای هوش مصنوعی، «آنتروپیک» شرکتهای هوش مصنوعی چین را به استخراج از مدل هوش مصنوعی «کلود» متهم میکند.

به گزارش شبکه خبری ICTPRESS به نقل از تک کرانچ، شرکت آنتروپیک سه شرکت هوش مصنوعی چینی را متهم کرده است که با استفاده از مدل هوش مصنوعی کلود آن بیش از ۲۴ هزار حساب کاربری جعلی راهاندازی کردهاند تا مدلهای خود را بهبود ببخشند.

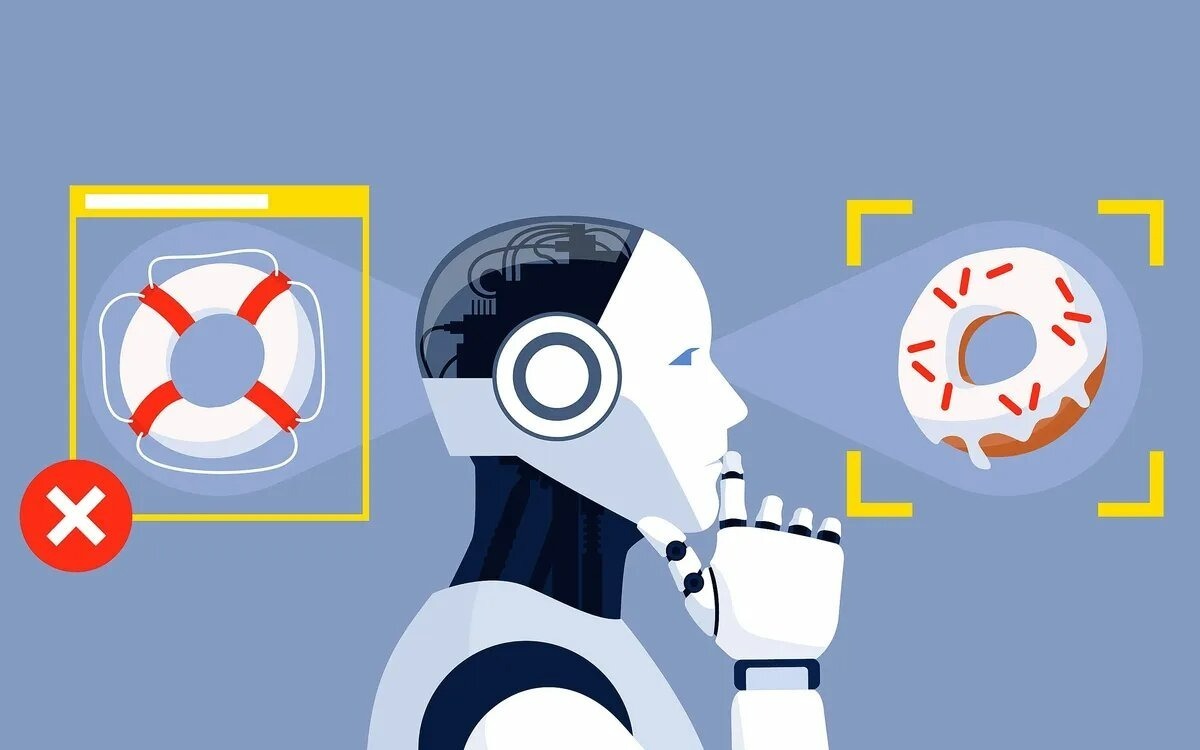

ظاهراً این شرکتها شامل دیپسیک، مونشات ایآی و مینیمکس با استفاده از روشی به نام «تقطیر دانش» بیش از ۱۶ میلیون تبادل با کلود را از طریق آن حسابها انجام دادهاند. شرکت آنتروپیک اعلام کرد که این آزمایشگاهها متمایزترین قابلیتهای کلود را از جمله استدلال عاملی، استفاده از فناوری و کدنویسی هدف قرار دادهاند.

این اتهامات در بحبوحه بحثهایی پیرامون چگونگی اعمال دقیق کنترل بر صادرات تراشههای پیشرفته هوش مصنوعی مطرح شدهاند که با هدف مهار توسعه هوش مصنوعی چین شکل گرفتهاند.

تقطیر دانش یک روش رایج است که آزمایشگاههای هوش مصنوعی از آن روی مدلهای خود برای ایجاد نسخههای کوچکتر و ارزانتر استفاده میکنند، اما رقبا میتوانند از آن برای کپی کردن کار سایر آزمایشگاهها استفاده کنند. شرکت اوپنایآی اوایل ماه جاری میلادی یادداشتی را به قانونگذاران مجلس نمایندگان آمریکا فرستاد و شرکت دیپسیک را به استفاده از تقطیر برای تقلید از محصولاتش متهم کرد.

دیپسیک اولین بار یک سال پیش با انتشار مدل استدلالی متنباز «R1» خود سروصدای زیادی راه انداخت که از نظر عملکرد با صرف کسری از هزینه تقریباً با آزمایشگاههای پیشرو آمریکا برابری میکرد.

انتظار میرود دیپسیک به زودی جدیدترین مدل خود موسوم به دیپسیک وی۴ را عرضه کند که از نظر کدنویسی میتواند عملکرد بهتری را نسبت به مدل کلود شرکت آنتروپیک و چتجیپیتی شرکت اوپنایآی داشته باشد.

مقیاس هر حمله از نظر دامنه متفاوت بود. آنتروپیک بیش از ۱۵۰ هزار تبادل دیپسیک را ردیابی کرد که به نظر میرسید با هدف بهبود منطق و همترازی بنیادین به ویژه پیرامون جایگزینهای ایمن از سانسور برای پرسوجوهای حساس به سیاست انجام شدهاند.

شرکت مونشات ایآی بیش از ۳.۴ میلیون تبادل داشت که استدلال عاملی و استفاده از فناوری، کدنویسی و تحلیل دادهها، توسعه عامل استفاده از رایانه و بینش رایانهای را هدف قرار میداد. ماه گذشته، این شرکت یک مدل متنباز جدید موسوم به «کیمی کی۲.۵»(Kimi K2.5) و یک عامل کدنویسی را عرضه کرد.

۱۳ میلیون تبادل مینیمکس، کدگذاری عاملی و استفاده از فناوری و هماهنگی را هدف قرار داده بودند. آنتروپیک اعلام کرد که توانسته عملکرد مینیمکس را مشاهده کند و دریافته این شرکت تقریباً نیمی از ترافیک خود را به قابلیتهای جدیدترین مدل کلود هدایت کرده است.

شرکت آنتروپیک میگوید به سرمایهگذاری در زمینههای دفاعی که اجرای حملات تقطیر را دشوارتر و شناسایی آنها را آسانتر میکند، ادامه خواهد داد، اما خواستار واکنش هماهنگ در سراسر صنعت هوش مصنوعی، ارائه دهندگان خدمات فضای ابری و سیاستگذاران است.

حملات تقطیر در زمانی رخ میدهند که صادرات تراشههای آمریکایی به چین هنوز موضوع داغی برای بحث است. ماه گذشته، دولت ترامپ رسماً به شرکتهای آمریکایی مانند انویدیا اجازه داد تراشههای پیشرفته هوش مصنوعی مانند H200 را به چین صادر کنند.

استدلال منتقدان این است که کاهش کنترل صادرات، ظرفیت محاسبات هوش مصنوعی چین را در برههای حساس از رقابت جهانی برای تسلط بر هوش مصنوعی افزایش میدهد.

آنتروپیک میگوید مقیاس استخراجی که دیپسیک، مینیمکس و مونشات انجام میدهند، نیازمند دسترسی به تراشههای پیشرفته است. در وبلاگ آنتروپیک آمده است: حملات تقطیر، منطق کنترل صادرات را تقویت میکند. دسترسی محدود به تراشه هم آموزش مستقیم مدل و هم مقیاس تقطیر غیرقانونی را محدود میکند.

دیمیتری آلپروویچ، رئیس اندیشکده «Silverado Policy Accelerator» و از بنیانگذاران شرکت کراوداسترایک گفت که از دیدن این حملات تعجب نکرده است.

آلپروویچ گفت: مدتی است که مشخص شده بخشی از دلیل پیشرفت سریع مدلهای هوش مصنوعی چینی، سرقت از طریق تقطیر مدلهای پیشگام آمریکایی بوده است. اکنون ما این موضوع را به طور قطعی میدانیم. این باید دلایل قانعکنندهتری را برای خودداری از فروش هرگونه تراشه هوش مصنوعی به هر یک از این (شرکتها) به ما بدهد.

مقامات آنتروپیک نیز گفتند که تقطیر نه تنها سلطه هوش مصنوعی آمریکا را تهدید میکند، بلکه میتواند خطرات امنیت ملی را نیز پدید آورد. در پست وبلاگ آنتروپیک آمده است: آنتروپیک و دیگر شرکتهای آمریکایی سیستمهایی را میسازند که مانع استفاده بازیگران دولتی و غیردولتی از هوش مصنوعی برای کارهایی مانند توسعه سلاحهای زیستی یا انجام دادن فعالیتهای سایبری مخرب میشوند.

مدلهایی که از طریق تقطیر غیرقانونی ساخته میشوند، بعید است که این ضمانتها را حفظ کنند و این بدان معناست که قابلیتهای خطرناک با حذف کامل بسیاری از محافظتها میتوانند تکثیر شوند.

نظرات : 0